Studie takzvaného centra výjimečnosti STRATCOM, které se takzvaným „trollingem“ a ruskými vlivovými i dezinformačními kampaněmi v pobaltských a severských zemích dlouhodobě zabývá, mapuje a zkoumá celkem 32 tisíc „tweetů“, které se od začátku března do konce srpna týkaly posílené vojenské přítomnosti NATO v Pobaltí a v Polsku v reakci spojenců na ruskou anexi Krymu a které pocházejí z některého z 11 600 aktivních uživatelských účtů.

RobotrollingKoordinované použití falešných účtů na sociálních sitích. Do kategorie falešných se v tomto případě zahrnují ty účty, které jsou ovládany jen počítačovými algoritmy - boty i ty ovládáné s určitými zásahy reálné osoby na různých stupních. Většina takových falešných robotických účtů se přitom vydává za skutečné osoby a využívají smyšlené identity. |

Jedna čtvrtina z nich používá ke komunikaci ruský jazyk, ostatní většinou angličtinu.

„Hlavním zjištěním je, že 70 procent těchto aktivních účtů v ruštině bylo převážně automatizováno,“ tvrdí autor studie Rolf Fredheim, specialista na automatické vyhledávání, archivaci a vizualizaci velkých datových souborů, umožňující analýzu šíření zpráv a dezinformací takřka v reálném čase.

Z anglicky tweetujících účtů je pak podle něj ovládáno 28 procent boty - počítačovými programy, které vykonávají na internetu automatizovanou činnost podobnou lidskému chování.

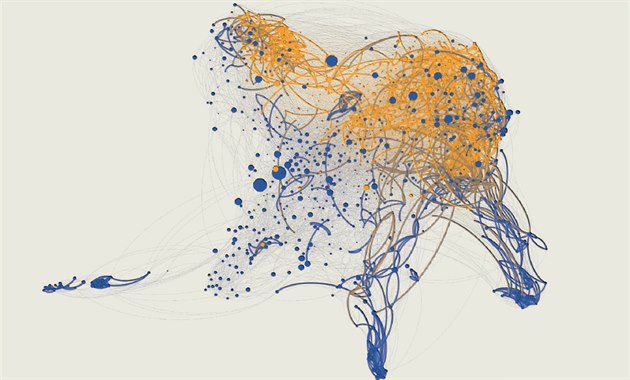

Automaticky vytvářený obsah robotických účtů se podle studie skládá z kombinace „neškodného obsahu“ (například prostřednictvím zpráv z oficiálních ruských médií), spamu a pak politicky motivovaného proruského obsahu. Zajímavá je podle studie i samotná twitterová komunikace botů, kteří „komunikují s dalšími boty“, propagující robotický obsah třetích stran a takovou provázanou sítí sami „postupně vytvářejí mnohem důvěryhodnější profily“.

Ruští boti vytvořili zhruba 84 procent všech ruských zpráv o NATO v pobaltských státech a v Polsku. Vysoká čísla podle Fredheima částečně vysvětluje propojení účtů ruských institucí a médií, které automaticky upozorňují na nové „příběhy“ a chovají se tak jako roboti.

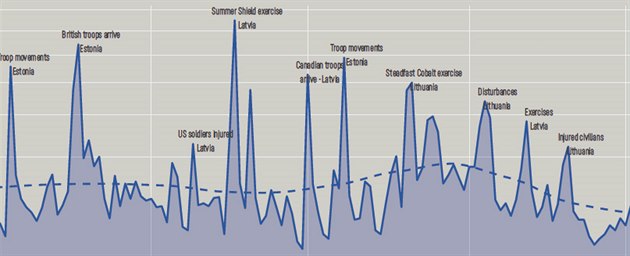

Ruskojazyčný obsah úzce souvisel se zpravodajskými informacemi a ruskou interpretací vojenských cvičení NATO v Pobaltí a Polsku, nasazení jednotek a tamějšími drobnými incidenty vojenského personálu.

Obsah v angličtině byl pak ovlivněn především tématy americké domácí a zahraniční politiky, především interpretací veřejných připomínek amerického prezidenta Donalda Trumpa k Alianci a také jeho návštěvou Polska.

V případě Estonska, o něm roboti „tweetovali“ podle statistik nejvíce (4 200 příspěvků), šlo především o nasazení kanadských vojáků nebo amerických letounů F-35 na estonském území. Velkou aktivitu v komentářích pak vyvolalo ruské narušení vzdušného prostoru Estonska v květnu a srpnu. Na druhém místě v hledáčku botů bylo Lotyšsko (2 600). Šlo o komentáře k aliančním cvičením a příchodu britských jednotek.

Polska a Litvy se se týkaly tweety botů nejméně (1 800 každý). V případě Polska šlo především o návštěvu Donalda Trumpa. Tu ale překonaly tweety o zatčení plukovníka polské armády podezřelého z pedofilie.

Zjištění tak přímo korespondují s nedávnými studiemi týmů Univerzity v Indianě a Oxfordu. Vzorek analyzující výlučně „zprávy“ o vojenské přítomnosti NATO v Pobaltí ale pochopitelně nemůže reprezentovat platformu Twitter jak celek a stejně tak jej nelze automaticky vztahovat i na další platformy a sociální média, konstatuje studie.

Ta upozorňuje, že v ruském twitterovém prostoru existují desítky prakticky shodných účtů automaticky produkujících značné množství prakticky totožného obsahu.

Tendence například v Evropě ukazují, že takovéto účty bývají zablokovány nebo zakázány během několika týdnů či měsíců od vytvoření. Mnoho z těchto automatizovaných ruských twitterových účtů však bylo podle studie vytvořeno už v letech 2011 a 2012, což znamená, že „jejich hyperaktivní chování je tolerováno více než pět let“.

Důvody v rozdílech mezi ruskojazyčným a anglickým prostorem na Twitteru a proč je ruský prostor zřejmě ovládán falešnými účty, spatřují autoři studie v tom, že neanglické prostory jsou ze strany Twitteru patrně kontrolovány mnohem méně efektivně a to vede k určitému tolerování „chování“, jež by jinak obvykle vedlo k pozastavení či zablokování účtu.

„Sociální média mohou občanům nabídnout alternativní prostor k vyjádření svých názorů. Schopnost Twitteru loužit této funkci je ohrožena, pokud objem falešné aktivity převažuje nad skutečným obsahem,“ uzavírá studie.

Američané ukazují dezinformace online

Síť twitterových účtů zaplavující falešnými zprávami a proruskými dezinformacemi internet sleduje také nedávno spuštěný projekt americké nadace German Marshall Fund.

Takzvaná „Aliance na obranu demokracie“ provozuje speciální stránky, které prakticky online zobrazují aktivity, statistiku a obsah 600 sledovaných twitterových účtů v angličtině, které v minulosti šířily dezinformace či se zapojily do ruských vlivových operací.

Hamilton 68Podle amerického federalistického politika a jednoho z otců zakladatelů Alexandera Hamiltona. Číslo pak odkazuje na jeden z takzvaných "Federálních listů", jejichž byl spoluautorem, ve kterém nabádá k obraně amerického volebního procesu před cizím vměšováním. |

On-line nástroj pojmenovaný jako „Hamilton 68“ poskytuje podle autorů „téměř v reálném čase přehled ruské propagandy a dezinformační snahy“. Zahrnuty jsou i zprávy z účtů ruských státem řízených médií jako Russia Today nebo Sputnik.

„Naším cílem je pomoci obyčejným lidem, novinářům a dalším analytikům identifikovat ruské tematické zprávy a odhalovat aktivní dezinformační nebo útočné kampaně, jakmile začnou,“ uvedla ředitelka projektu Laura Rosenbergerová.

Některé ze sledovaných a navzájem propojených účtů podle autorů rovněž ovládají boti, jiné jsou skutečné osoby. Sledované účty autoři projektu vybrali ze třech směrů. Nejprve sledovali dezinformační kampaně, které se synchronizovaly s otevřenými ruskými propagandistickými „kiosky“ jako právě Sputnik a Russia Today. Pak analyzovali propojení sociální sítě uživatelů, kteří takové dezinformace propagovali, aby zjistili, kteří uživatelé jsou centrálně napojení a odfiltrovali ty, kteří dezinformace sdíleli a šířili víceméně náhodně.

V druhém směru posléze rozklíčovali skupinu online uživatelů, která se otevřeně hlásí k proruským postojům a vědomě dezinformace šíří i vytvářejí. Analyzovali také ty, kteří jejich účty sledují v rámci masivní a vzájemně propojené sociální sítě předávající si prakticky totožná témata a obsah.

Ve třetím směru pak detekovali účty, které s největší pravděpodobností ovládají boti - zcela autonomně nebo poloautonomně s určitými zásahy skutečných osob. Slouží k masivnímu zesílení šířených dezinformací. Takové účty měly při analýze v denním měřítku neobvykle vysoké interakce s jinými účty, včetně odesílání a přijímání „retweetů“, i vysoké počty vlastních komentářů.

Vzorky z každé z těchto tří skupiny byly pak zkombinovány kombinovány tak, aby poskytly reprezentativní snímek ruských vlivových operací na Twitteru, tvrdí autoři.

V rámci sítě pak existují četné podskupiny, které se specializují na určitý druh obsahu, jako například na Ukrajinu, Sýrii nebo krajní pravici.

Summit NATO 2023

Summit NATO 2023

tisknout

tisknout